O Distilbert Huggingface foi criado e introduzido em 2019 como uma versão leve do modelo BERT original. Esta versão fornece aos desenvolvedores e pesquisadores uma ferramenta mais eficiente para executar tarefas de PNL sem a necessidade de utilizar grandes recursos computacionais.

Este artigo explora como esse modelo funciona para resolver tarefas de processamento de linguagem humana. Você também aprenderá como ele pode ser usado e em quais campos. Além disso, ao ler este guia, você saberá como usar um cenário Latenode que envolve uma integração direta com a arquitetura Distilbert.

Key Takeaways: O Distilbert, criado pela Hugging Face em 2019, é uma versão leve do modelo BERT projetada para tarefas de PNL eficientes com recursos computacionais reduzidos. Ele usa a destilação para transferir conhecimento de um modelo maior (BERT) para um menor, melhorando o desempenho e a velocidade, mantendo a precisão. Usado em campos como automação de suporte ao cliente, gerenciamento de reputação, análise de dados médicos, educação e marketing, o DistilBERT pode ser integrado ao Latenode para processos de negócios simplificados. Um cenário Latenode mostra a capacidade do DistilBERT de automatizar a classificação de avaliações de clientes, demonstrando suas aplicações práticas.

Destilbert de rosto abraçado é um modelo de IA para processamento e classificação de linguagem natural. É uma versão retrabalhada do modelo BERT (Bidirectional Encoder Representations from Transformers) original, mas mais leve para melhor desempenho e velocidade. O método usado na operação deste modelo é chamado destilação.

A destilação envolve a transferência de conhecimento do professor (ou seja, o modelo maior - BERT) para o estudante, (o modelo menor, Distillbert). Nesta abordagem, o último é treinado para prever e analisar dados com base na saída do primeiro. Isso inclui usar as probabilidades previstas pelo professor como rótulos suaves, o que ajuda o aluno a captar padrões sutis e melhora sua capacidade de analisar e classificar informações.

A principal vantagem deste modelo de IA é seu desempenho. Ele requer menos recursos computacionais para treinamento e predição, tornando-o ideal para ambientes com recursos limitados. Por exemplo, Arquitetura de Destilbert pode ser implementado em dispositivos com memória e poder de processamento limitados, onde o uso de BERT é impossível.

Ao mesmo tempo, essa arquitetura de IA pode ser treinada em grandes conjuntos de dados, o que fornece alta precisão de previsão. Isso é útil, por exemplo, para desenvolvedores e pesquisadores que precisam analisar grandes quantidades de texto. Por causa disso, Destilar Bert é considerado um poderoso modelo moderno de processamento de linguagem natural.

Ele fornece uma solução equilibrada para tarefas de PNL, entregando alto desempenho e precisão com menos consumo de recursos. Ele encontrou aplicações que vão do processamento de feedback do cliente à automação de help desk, tornando a tecnologia avançada acessível a um público amplo. Veja abaixo para saber onde o modelo Distillbert pode ser usado.

Devido à sua compactação e eficiência, o modelo se tornou uma ferramenta valiosa em várias indústrias onde a comunicação humana e a validação de texto desempenham um papel crucial. Sua capacidade de processar e entender a linguagem natural ajuda a automatizar e resolver várias tarefas. Aqui estão alguns campos impactados por este modelo:

Uma de suas principais áreas de aplicação é a automação do suporte ao usuário. Muitas empresas integram o Distilled Bert em seus chatbots e sistemas de suporte para lidar automaticamente com consultas de clientes, fornecer respostas rápidas e precisas e redirecionar perguntas complexas para operadores ao vivo. Isso ajuda a reduzir a carga de trabalho dos funcionários e melhorar a qualidade do serviço.

Outra área de aplicação importante do modelo Distilbert Huggingface é analisar o tom em mídias sociais e avaliações de produtos. As empresas usam esse modelo para monitorar avaliações de clientes e menções em mídias sociais para entender como os usuários percebem seus produtos ou serviços. O modelo ajuda a categorizar automaticamente as avaliações em positivas, negativas e neutras, permitindo que eles respondam aos comentários e melhorem sua reputação.

O modelo Distilbert pode processar grandes volumes de registros médicos e categorizar informações importantes sobre o paciente, o que acelera o processo de diagnóstico e tratamento. Por exemplo, ele pode ser usado para categorizar sintomas automaticamente, extrair diagnósticos de texto e até mesmo gerar recomendações baseadas em protocolo.

O Huggingface Distilbert também é usado para automatizar a validação de texto e analisar as respostas dos alunos. Plataformas educacionais integram esse modelo para avaliar redações, detectar plágio e analisar a proficiência no idioma. Isso reduz o tempo gasto na verificação de tarefas e fornece uma avaliação mais objetiva do conhecimento dos alunos. Além disso, ele pode ser usado para criar assistentes inteligentes que ajudam os alunos com tarefas de casa e preparação para exames.

O Distill Bert é usado ativamente em marketing e publicidade. As empresas o usam para analisar o comportamento do consumidor, segmentar públicos e criar campanhas publicitárias personalizadas. Ele ajuda a analisar dados textuais de pesquisas, avaliações e mídias sociais, permitindo que os profissionais de marketing entendam as necessidades e preferências dos clientes e adaptem suas estratégias para interagir com seu público-alvo.

O Distillbert Huggingface também pode ser usado para automatizar processos de negócios em um fluxo de trabalho simples do Latenode. Você pode criar um algoritmo funcional que executa tarefas de rotina em vez da sua equipe vinculando nós de gatilho e ação com integrações de baixo código. Dê uma olhada abaixo no que é o Latenode. Você também verá um modelo de script com este modelo de IA que você pode copiar para experimentar.

Latenode é uma ferramenta de automação de fluxo de trabalho que permite que você integre diferentes nós em seu script. Cada nó representa um específico açao or desencadear. Simplificando, quando um gatilho é disparado, ele imediatamente leva a uma sequência de ações: adicionar informações a uma planilha do Google, atualizar um banco de dados ou enviar uma mensagem em resposta a uma ação do usuário.

Cada nó pode incluir integrações de baixo código, de arquiteturas de IA como Distilled bert a serviços como Google Sheets, Chat GPT, Airbox e muitos outros. Existem centenas dessas integrações na biblioteca Latenode e, se você não encontrar o serviço que está procurando, publique uma solicitação em Roadmap ou use o pago Lançamento do aplicativo First-Track serviço.

Além das integrações diretas, os nós podem incluir Código Javascript que você ou um assistente de IA pode escrever com base no seu prompt. Isso permite que você vincule seu script a serviços de terceiros, mesmo que eles não estejam na coleção, ou adicione funções personalizadas ao seu script. O assistente também pode explicar ferramentas como Distillbert, Resnet, etc., depurar código existente, esclarecer fórmulas ou até mesmo sugerir a estrutura de scripts que você pode ajustar.

O Latenode também pode se comunicar com vários sistemas de API, simplificando ainda mais a automação. Imagine poder extrair dados do Google Maps ou enriquecer-se automaticamente com dados sobre seus usuários que se registram em seu site. As possibilidades dos scripts automatizados são enormes, e o serviço está em constante evolução.

Se precisar de ajuda ou conselhos sobre como criar seu próprio script ou se quiser replicar este, entre em contato nossa comunidade no Discord, onde estão localizados os especialistas em automação de baixo código.

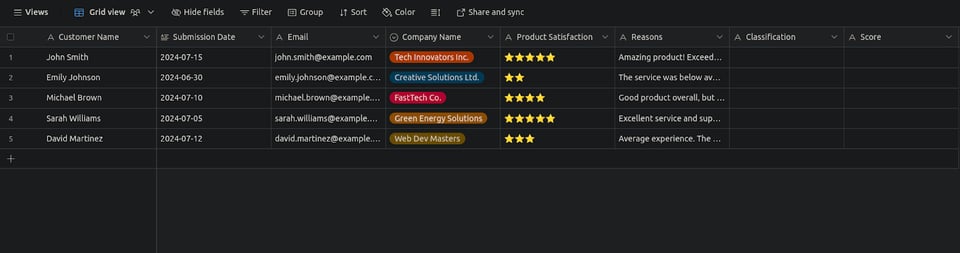

Este script automatiza o gerenciamento das avaliações dos seus clientes e as classifica como positivas ou negativas, dependendo da resposta do nó de integração do Distilbert.

Para criar este script, copie este modelo em sua conta Latenode para personalizá-la, se necessário. Você também precisará de uma conta registrada Conta Airtable para fazer uma tabela. O script compreende seis nós e não requer chaves de API, codificação ou outras habilidades técnicas. Aqui estão as etapas detalhadas para implementar cada nó:

.jpeg)

.jpeg)

Quando você inicia o fluxo de trabalho, a primeira integração do Airtable extrai a lista de avaliações e detalhes do cliente do banco de dados. Pode ser qualquer banco de dados do Airtable onde você armazena suas informações, não apenas aquele que este modelo usa. Em seguida, as informações passam pelo nó de iteração para o Distill bert, que analisa o texto e produz um pontuação de probabilidade.

Com base nessa pontuação, os dados são roteados para um dos dois seguintes nós Airtable. Se a pontuação for 0.99, um sinal é enviado para a integração Airtable superior para classificá-lo como positivo na tabela. Se o resultado for o oposto, um sinal semelhante é enviado ao nó inferior para que ele o classifique como negativo. Além disso, esses nós postam a pontuação na tabela. Aqui está como deve ficar:

Este fluxo de trabalho ajudará você a economizar tempo lendo rapidamente publicações positivas ou negativas. Por exemplo, você pode filtrar avaliações para exibir apenas as negativas para entrar em contato com seus autores e ver áreas onde o serviço pode ser melhorado, ou entrar em contato com usuários que postaram depoimentos positivos para agradecê-los pelo interesse e feedback.

As capacidades do modelo AI Distillbert são multifacetadas. Este modelo permite que você categorize informações em vários fluxos, analise grandes volumes de dados de texto, automatize FAQs, crie chatbots, personalize o conteúdo do usuário, aprimore mecanismos de busca com recomendações aprimoradas, etc.

Seja você um desenvolvedor experiente ou um novato em IA, as aplicações potenciais do Distilbert podem transformar seus projetos. Imagine alavancar esta ferramenta poderosa para criar soluções inteligentes de suporte ao cliente, otimizar sistemas de gerenciamento de conteúdo ou desenvolver estruturas sofisticadas de análise de dados.

Tente criar um cenário você mesmo com este modelo! O Latenode oferece uma versão gratuita que permite que você configure até 20 fluxos de trabalho ativos com nós ilimitados. No entanto, ativar cada fluxo de trabalho usa 1 dos seus 300 créditos disponíveis. Se você precisar de mais créditos, tempos de ativação mais rápidos, acesso ao AI Code Copilot, contas conectadas ilimitadas e vantagens adicionais, visite o página de inscrição!

Você pode compartilhar seus métodos de desenvolvimento usando o recurso Shared Templates ou na comunidade Discord do Latenode. No Comunidade Discord, você pode se conectar com outros desenvolvedores, relatar bugs, sugerir melhorias de serviço e obter novos insights sobre ferramentas de automação de negócios, como o Distilbert ou outros modelos de IA!

O Distilbert é uma versão simplificada e eficiente do modelo BERT criado pela Hugging Face para tarefas de processamento de linguagem natural, introduzido em 2019. Ele mantém alto desempenho enquanto usa menos recursos computacionais.

O Distillbert usa um processo chamado destilação, onde o conhecimento de um modelo maior (BERT) é transferido para um modelo menor. Isso envolve treinar o modelo menor para prever e analisar dados com base na saída do modelo maior.

O modelo Distilbert é usado em automação de suporte ao cliente, análise de sentimentos em mídias sociais, processamento de registros médicos, plataformas educacionais e análise de marketing devido à sua compacidade e eficiência.

Latenode é uma ferramenta de automação de fluxo de trabalho que permite a integração de vários nós, incluindo ferramentas de IA como o modelo Distilbert, para automatizar e agilizar processos de negócios com configurações de baixo código.

Um cenário de exemplo envolve automatizar a classificação de avaliações de clientes. O DistilBERT analisa o texto para determinar o sentimento, e o Latenode encaminha os dados para nós apropriados, atualizando um banco de dados com avaliações e pontuações classificadas.

O Distilled Bert oferece alta precisão semelhante à do BERT, mas com requisitos computacionais significativamente reduzidos, tornando-o ideal para ambientes com recursos limitados, como dispositivos móveis e aplicativos em tempo real.

Você pode começar integrando a arquitetura do Distilbert em ferramentas de automação de fluxo de trabalho como o Latenode, que fornece uma interface amigável para configurar processos baseados em IA com conhecimento mínimo de codificação necessário.