Retrieval Augmented Generation (RAG) Platform

Build AI agents with real memory using our retrieval augmented generation platform. Turn documents into searchable knowledge for smarter, context-aware answers.

RAG as a service — no vector DBs, no complex setup. Just upload & go.

RAG is Essential for AI Agents

Retrieval augmented generation gives your AI agents long-term memory. Without RAG, agents are limited to prompts and real-time data — they can't access your unique knowledge base or remember past interactions.

RAG changes that. By storing and indexing your documents, images, and structured data, your agents can:

- Answer with precision — retrieving only the most relevant facts.

- Stay consistent — using the same source of truth for every reply.

- Scale effortlessly — no need to retrain models or rewrite prompts for new data.

This means fewer hallucinations, faster responses, and higher trust from your users — all while keeping control of your proprietary information.

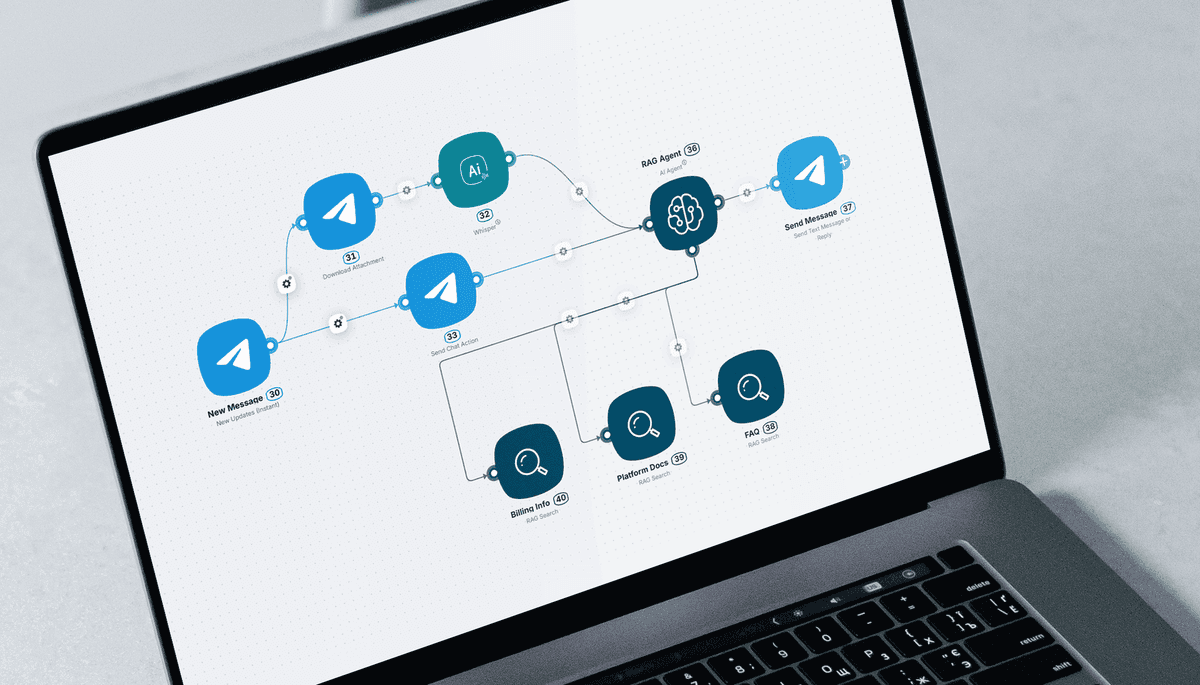

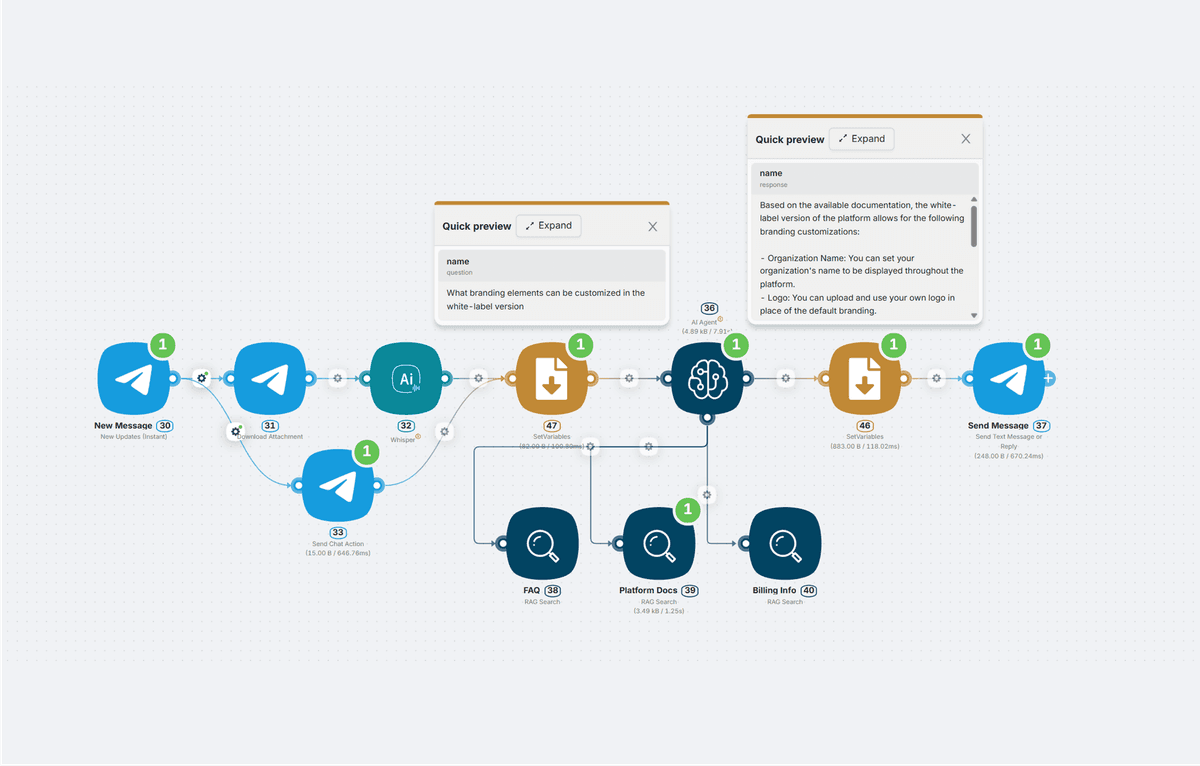

How to Implement Retrieval Augmented Generation

Upload & Index

Drag-and-drop PDFs, text, images (with OCR), or other files. We automatically chunk and embed them for high-accuracy retrieval.

Search Instantly

Add a RAG Search node to any workflow, pick your storage, ask in plain language, and get the most relevant chunks in milliseconds.

Power Smarter Agents

Connect the search results directly to an AI Agent node so your bots can answer with context from your docs — whether for chat, support, or multi-agent automations.

This retrieval augmented generation workflow lets you build document-aware AI agents in minutes — no retrieval queries or vector database management required.

Why Choose Our RAG Platform for LLMs

Faster Deployment

Go from upload to live agent in minutes.

No API Hassles

Access all top LLMs via one subscription.

Smarter Agents

Answer with context, not just guesswork.